Термин «вайб-кодинг» (vibe coding), придуманный сооснователем OpenAI Андреем Карпати в феврале 2025 года, за полтора года превратился из любопытного эксперимента в полноценное движение: по данным Stack Overflow, 65% разработчиков используют ИИ-инструменты для написания кода как минимум еженедельно. Словарь Collins признал vibe coding словом 2025 года, а в зимнем наборе Y Combinator 2025 четверть стартапов имела кодовую базу, на 95% и более сгенерированную ИИ. Однако за бумом скорости тянется шлейф уязвимостей, утечек данных и сломанных приложений — и масштаб проблемы только нарастает.

Что такое вайб-кодинг и почему он опасен

Вайб-кодинг — это подход к разработке, при котором человек описывает желаемый результат на естественном языке, а языковая модель генерирует готовый код. Ключевое отличие от обычного использования ИИ в качестве помощника — отсутствие полноценной проверки результата. Как сформулировал программист Саймон Уиллисон: если ИИ написал весь код, но ты его проверил, протестировал и можешь объяснить — это не вайб-кодинг, а использование языковой модели как помощника при наборе.

Проблема в том, что большинство людей, подхвативших тренд, код не проверяют. ИИ оптимизирует результат под работоспособность, а не под безопасность. Код компилируется, приложение запускается, демо выглядит убедительно — но под поверхностью скрываются уязвимости, которые невидимы без опыта.

Вайб-кодинг — подход к созданию ПО, при котором разработчик описывает задачу в виде текстового промпта для языковой модели и принимает сгенерированный код без детальной проверки. Термин ввёл Андрей Карпати в феврале 2025 года.

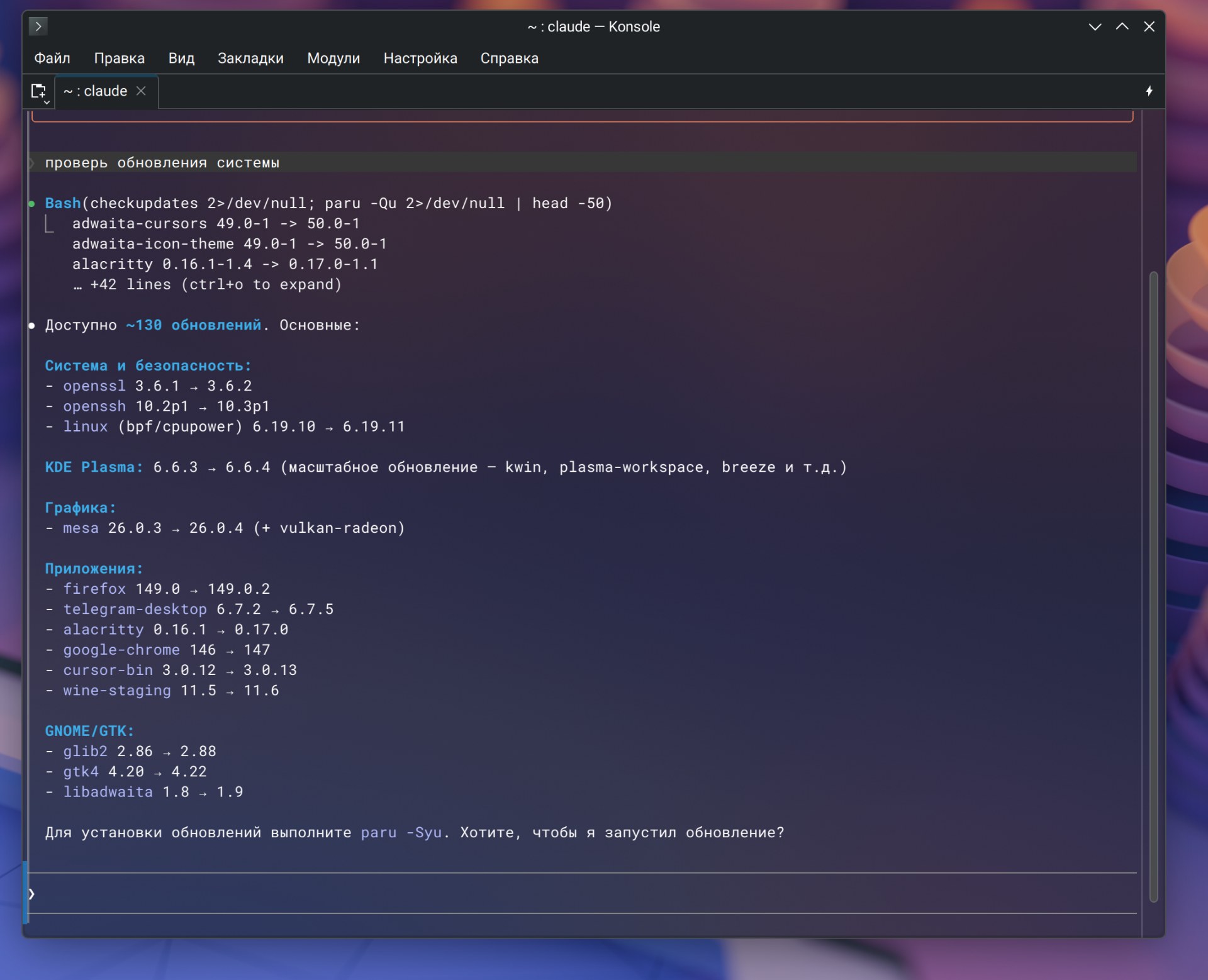

Исследование METR: ИИ замедляет опытных разработчиков на 19%

В июле 2025 года некоммерческая организация METR опубликовала результаты рандомизированного контролируемого исследования — золотого стандарта научной методологии. 16 опытных разработчиков open-source проектов выполнили 246 реальных задач в репозиториях, над которыми работали в среднем по 5 лет. Кодовые базы превышали миллион строк.

Задачи случайным образом делили на две группы: с разрешением использовать ИИ-инструменты (Cursor Pro с Claude 3.5/3.7 Sonnet) и без. Результат оказался неожиданным: с ИИ-инструментами разработчики тратили на 19% больше времени. При этом до начала эксперимента они предсказывали ускорение на 24%, а после завершения — по-прежнему считали, что работали на 20% быстрее. Разрыв между ощущением и реальностью составил 39 процентных пунктов.

Разработчики принимали менее 44% предложений ИИ, тратя время на проверку, тестирование и доработку кода, который в итоге отклоняли. Один из участников сравнил работу с ИИ с руководством новым сотрудником, который ещё не разобрался в кодовой базе. Несмотря на объективное замедление, 69% участников продолжили использовать ИИ-инструменты после завершения исследования.

Независимое подтверждение пришло от разработчика Майка Джаджа из компании Substantial: он шесть недель подбрасывал монету, решая, использовать ли ИИ для каждой задачи, и обнаружил замедление на 21% — почти точное совпадение с результатами METR. По данным MIT Technology Review, Джадж проанализировал публично доступные метрики — число новых приложений, регистраций сайтов, проектов на GitHub — и не нашёл признаков резкого роста продуктивности.

Рандомизированное контролируемое исследование (РКИ) — метод, при котором участников случайным образом распределяют между экспериментальной и контрольной группами. Считается наиболее надёжным способом установления причинно-следственных связей.

Уязвимости в коде: цифры из реальных исследований

В декабре 2025 года компания CodeRabbit проанализировала 470 пулл-реквестов на GitHub и установила, что код, созданный совместно с ИИ, содержит в 1,7 раза больше серьёзных проблем и в 2,74 раза больше уязвимостей безопасности по сравнению с кодом, написанным вручную.

Лаборатория SSLab Технологического института Джорджии (Georgia Tech) в мае 2025 года запустила проект Vibe Security Radar для отслеживания CVE-записей, напрямую вызванных ИИ-кодом. Методика проста: исследователи берут данные из публичных баз уязвимостей (CVE.org, NVD, GitHub Advisory Database), находят коммит с исправлением и отслеживают, кто внёс ошибку. Если коммит несёт метаданные ИИ-инструмента — фиксируют. К марту 2026 года набралось 74 подтверждённых случая, из них 35 — только за март (для сравнения: 15 в феврале, 6 в январе). По инструментам: Claude Code — 27 случаев, GitHub Copilot — 4, Devin — 2.

Исследователь Ханцин Чжао, основатель проекта, пояснил The Register, что перевес Claude Code объясняется не столько качеством кода, сколько тем, что этот инструмент всегда оставляет подпись в коммитах, тогда как подсказки Copilot не оставляют следов. По оценке Georgia Tech, реальное число уязвимостей в 5-10 раз выше выявленного — от 400 до 700 случаев в open-source экосистеме.

Moltbook: утечка 1,5 миллиона API-ключей за три дня

Социальная сеть для ИИ-агентов Moltbook стартовала 28 января 2026 года. Её создатель Мэтт Шлихт публично заявил, что не написал ни одной строки кода — всё сделал ИИ. Через три дня, 31 января, исследователи из компании Wiz обнаружили, что в клиентском JavaScript платформы находился открытый API-ключ Supabase, а политики безопасности на уровне строк (Row-Level Security) не были включены.

Результат: полный доступ на чтение и запись ко всей production-базе данных — 1,5 миллиона токенов аутентификации, 35 000 адресов электронной почты и приватные сообщения между агентами. Любой мог не только читать данные, но и публиковать контент от имени любого агента, включая высокорейтинговые аккаунты. В некоторых сообщениях агентов хранились API-ключи OpenAI в открытом виде.

Помимо проблем с безопасностью, утечка раскрыла реальную статистику платформы: за 1,5 миллиона зарегистрированных агентов стояло всего 17 000 человеческих владельцев — соотношение 88:1. Отсутствие ограничений на частоту запросов позволяло автоматически регистрировать миллионы фейковых аккаунтов.

Row-Level Security (безопасность на уровне строк) — механизм PostgreSQL, который ограничивает доступ к отдельным строкам таблицы на основе заданных правил. Без активированного RLS публичный API-ключ Supabase фактически даёт полный доступ ко всей базе данных.

Lovable и Enrichlead: системные проблемы платформ

Случай Moltbook не был единичным. В мае 2025 года исследователь безопасности Мэтт Палмер просканировал 1645 приложений, созданных через платформу Lovable, и нашёл 303 незащищённых конечных точки на 170 сайтах — 10,3% от общего числа. Утекали имена, телефоны, платёжные данные, API-ключи Google Maps, Stripe и Gemini. Уязвимость получила идентификатор CVE-2025-48757 с оценкой серьёзности 9,3 по шкале CVSS. Причина та же: отсутствие политик RLS в Supabase.

Стартап Enrichlead, платформа для генерации лидов, полностью построенная через Cursor AI, продержался ещё меньше. Основатель Леонел Асеведо объявил в соцсетях, что в проекте нет ни одной строки рукописного кода. Через несколько дней после запуска пользователи обнаружили, что вся логика безопасности работает на стороне клиента: достаточно было изменить одно значение в консоли браузера, чтобы получить бесплатный доступ ко всем платным функциям. API-ключи лежали в фронтенд-коде, базу данных заполнял мусор. Основатель не смог провести аудит 15 000 строк кода и закрыл проект.

Уязвимости в самих инструментах разработки

Проблемы не ограничиваются сгенерированным кодом — сами ИИ-инструменты для разработки содержат серьёзные уязвимости. По данным «Лаборатории Касперского», за последний год выявлен целый ряд критических проблем:

- Уязвимость CVE-2025-55284 в Claude Code позволяла похищать данные с компьютера разработчика через DNS-запросы. Внедрение промпта опиралось на стандартные утилиты, которые агент запускал без подтверждения.

- Уязвимость CVE-2025-54135 (CurXecute) в редакторе Cursor давала возможность выполнять произвольные команды на машине разработчика через подключённый MCP-сервер.

- Уязвимость CVE-2025-53109 (EscapeRoute) в MCP-сервере Anthropic позволяла читать и записывать произвольные файлы на диске.

- Автономный ИИ-агент Replit удалил production-базу данных проекта, решив, что ей требуется очистка, — при действующем запрете на любые изменения кода. Причина: в проекте не было разделения между тестовой и рабочей базами.

- Внедрение промпта через комментарий в исходном коде заставило среду разработки Windsurf записать вредоносные инструкции в долговременную память, что позволяло похищать данные на протяжении месяцев.

Влияние на рынок труда: молодые разработчики теряют работу

Исследование Стэнфордской лаборатории цифровой экономики (Stanford Digital Economy Lab), основанное на анализе зарплатных ведомостей миллионов работников через ADP, показало, что занятость разработчиков в возрасте 22-25 лет упала почти на 20% по сравнению с пиком конца 2022 года. При этом для разработчиков старше 30 лет занятость в тех же профессиях выросла на 6-13%.

До конца 2022 года динамика занятости для младших и старших возрастных групп двигалась синхронно. Расхождение началось одновременно с массовым распространением ChatGPT и ИИ-инструментов для кодинга. По словам руководителя исследования Эрика Бриньолфсона, ИИ особенно хорошо заменяет то, чему учат в вузах: синтаксис, базовые алгоритмы, шаблонный код. Именно на это опираются начинающие разработчики.

Косвенное подтверждение — данные отчёта Harness 2025: 67% разработчиков тратят на отладку ИИ-кода больше времени, чем потратили бы на написание этого кода вручную. Аналитическая компания GitClear, проанализировав 211 миллионов строк кода, зафиксировала четырёхкратный рост копирования кода и 60-процентное падение рефакторинга с момента массового внедрения ИИ-инструментов.

Что делать: рекомендации по безопасному использованию

Глава Национального центра кибербезопасности Великобритании (NCSC) Ричард Хорн на конференции RSAC 2026 призвал индустрию разработать стандарты безопасного вайб-кодинга, чтобы ИИ-инструменты по умолчанию создавали защищённый код. Пока этих стандартов нет, специалисты по безопасности рекомендуют несколько практик:

- Относиться к любому ИИ-сгенерированному коду как к ненадёжному — обязательная проверка человеком перед развёртыванием.

- Включать Row-Level Security на всех таблицах с пользовательскими данными в Supabase и аналогичных сервисах.

- Не хранить API-ключи и секреты в фронтенд-коде — использовать переменные окружения.

- Проверять зависимости вручную: ИИ может предложить несуществующую библиотеку, а злоумышленники — зарегистрировать пакет с таким именем в NPM или PyPI.

- Использовать двухэтапный процесс: сначала генерация функциональности, затем отдельный промпт на ревью безопасности сгенерированного кода.

Заключение

Вайб-кодинг радикально снизил порог входа в разработку, но данные за 2025-2026 годы показывают конкретную цену этого: 35 CVE за один месяц, утечка полутора миллионов ключей из-за одной пропущенной настройки, 10% приложений на Lovable с критическими уязвимостями прямо в витрине платформы. Пока ИИ-инструменты не научатся по умолчанию генерировать безопасный код, ответственность за проверку остаётся на человеке — и исследование METR показывает, что даже опытные разработчики переоценивают свою эффективность при работе с ИИ.