OpenAI выпустили ChatGPT Images 2.0 – обновление генератора изображений с моделью gpt-image-2, которая появилась в ChatGPT, Codex и по API 2026 года. Базовая версия доступна всем пользователям ChatGPT, включая бесплатный тариф. Расширенный режим с рассуждением, веб-поиском и генерацией до восьми согласованных изображений из одного запроса включён только для подписчиков Plus, Pro, Business и Enterprise.

Что именно изменилось в отрисовке текста

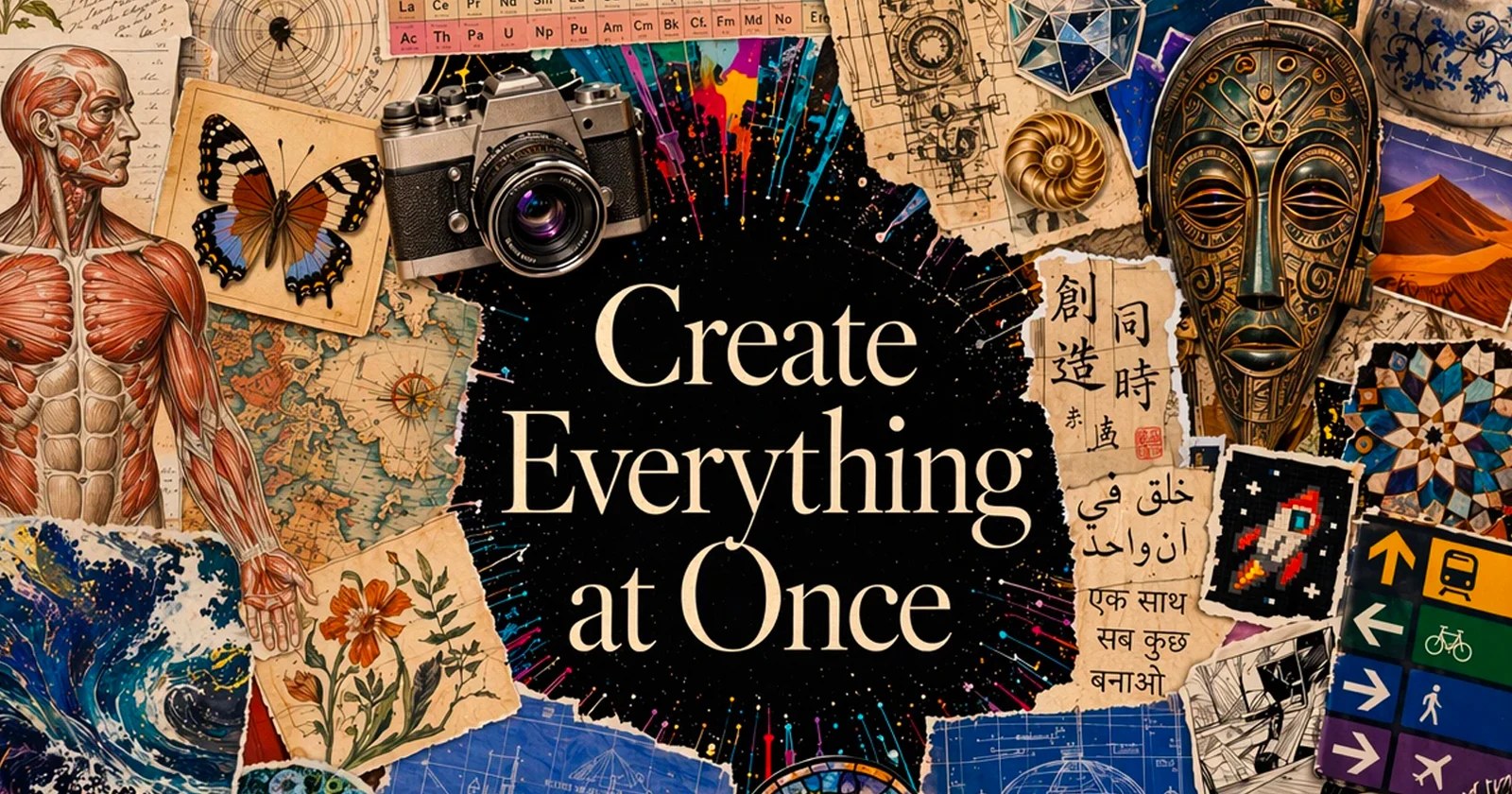

В предыдущих поколениях изображения с надписями выдавали искусственное происхождение сразу: названия коверкались, мелкий шрифт превращался в нечитаемую кашу, а попытка сгенерировать плотный текстовый блок заканчивалась набором похожих на буквы символов. В gpt-image-2 этот барьер снят: модель справляется с мелкими шрифтами, иконографией, элементами интерфейса, плотными композициями и разрешением до 2K по API.

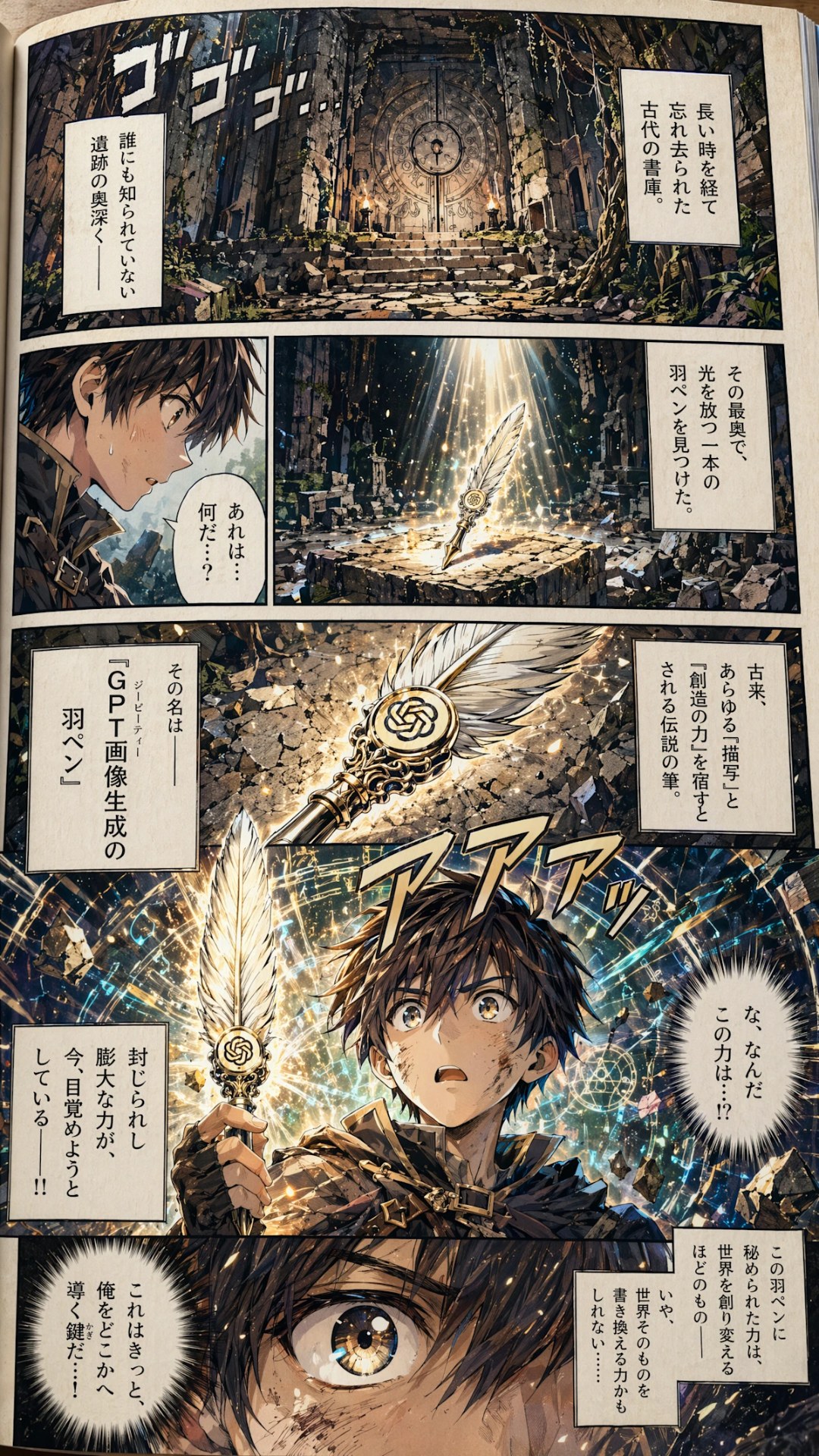

OpenAI описывают результат своим манифестом: «Изображения – это язык, а не украшение». Практический эффект ровно такой: для большинства типовых задач (меню ресторана, макет инфографики, обложка журнала, многокадровый комикс) достаточно одного запроса, и результат не требует ручного правления текста в графическом редакторе.

Режим Thinking: рассуждение до генерации

Главное архитектурное нововведение Images 2.0 – первый в линейке OpenAI режим рассуждения для генерации изображений. В режиме рассуждения модель сначала анализирует запрос, затем обращается к веб-поиску за актуальной информацией, продумывает композицию и только после этого рисует. В качестве побочного эффекта из одного запроса получаются до восьми связанных изображений с единым персонажем и стилем – это закрывает самую больную задачу прикладной графики: раскадровки, серии рекламных баннеров, многостраничные комиксы, набор скриншотов для рекламы приложения.

Thinking-режим – расширенный вариант работы модели, при котором перед генерацией выполняется цепочка рассуждений и внешние запросы (в частности, поиск в интернете). Время ожидания растёт, качество сложных композиций повышается. Доступен только на платных тарифах ChatGPT.

Для сравнения: базовый режим Instant выдаёт одну картинку быстро и доступен на всех тарифах, включая бесплатный. Пользователи Plus, Pro, Business и Enterprise получают дополнительно Thinking и Pro. Enterprise-клиенты заявлены с поэтапным включением.

Языки и нелатинские алфавиты

OpenAI отдельно подчёркивают прогресс в языках с нелатинской графикой: японском, корейском, хинди и бенгальском. В официальном списке OpenAI присутствует также китайский. Это снимает ограничение, из-за которого локализованные макеты (упаковка, вывески, меню, инфографика) приходилось собирать вручную или через отдельные пайплайны по каждому языку.

Граница знаний модели – декабрь 2025 года. На запросах, связанных с событиями после этой даты, точность падает, и в Thinking-режиме модель при необходимости подтягивает данные из сети.

Форматы и разрешение

Images 2.0 поддерживает соотношения сторон от 3:1 (широкие баннеры, презентации) до 1:3 (мобильные вертикали, закладки, истории в соцсетях). Максимальное разрешение по API – 2K. Это закрывает типовые форматы готовой графики без пост-обработки: баннеры, слайды, постеры, обложки.

Архитектура и цены API

OpenAI отказались раскрыть тип архитектуры gpt-image-2. В пресс-брифинге представитель компании не подтвердил, используется ли диффузионная модель, авторегрессионная или гибридный подход, ограничившись формулировкой «GPT для изображений». Такая скрытность контрастирует с тем, что ранее в TechCrunch разбирали: диффузионные модели исторически плохо рисовали текст, потому что реконструируют изображение из шума, и буквы занимают малую долю пикселей, которые сеть «учится закрашивать». Авторегрессионные модели, напротив, предсказывают изображение по частям, как языковые модели предсказывают следующий токен.

Диффузионная модель – тип генератора изображений, который начинает со случайного шума и постепенно убирает его, восстанавливая картинку. Авторегрессионная модель – генератор, который строит изображение последовательно, как языковая модель собирает текст по одному токену, что облегчает воспроизведение структурированных элементов вроде текста и интерфейса.

Официальные цены API на странице платформы OpenAI: за 1 млн токенов изображений на входе – 8 долларов, кэшированный вход – 2 доллара, вывод – 32 доллара; текстовый вход – 5 долларов, кэшированный – 1,25 доллара, вывод – 10 долларов. Конкретная стоимость одной картинки зависит от выбранного качества, разрешения и наличия рассуждения.

Что происходит с DALL·E

Релиз gpt-image-2 ложится на фоновое изменение в линейке OpenAI: DALL·E 2 и DALL·E 3 сняты с поддержки и будут отключены 12 мая 2026 года. Модель gpt-image-1.5 остаётся в API как предыдущее поколение. Фактически gpt-image-2 закрывает собой сразу две задачи: наследует роль DALL·E как массового генератора в ChatGPT и претендует на место флагманской модели для коммерческих задач.

Конкуренция с Nano Banana 2

Thinking-режим – не изобретение OpenAI, а ответ на рынок. В ноябре 2025 года Google DeepMind выпустили Nano Banana Pro (Gemini 3 Pro Image) с рассуждением и реальными знаниями при генерации, а в феврале 2026 года – Nano Banana 2 (Gemini 3.1 Flash Image) с быстрой архитектурой по сопоставимому качеству, разрешением до 4K и плотным текстом, встроенным в изображение. Nano Banana Pro также поддерживает многоязычный рендеринг и загрузку до 14 референсных изображений для удержания фирменного стиля. Images 2.0 догоняет по ключевым функциям: рассуждению, веб-поиску на этапе генерации, последовательности персонажей и высококачественному тексту.

Ограничения, о которых заявляет сама OpenAI

Даже при рассуждении сложности остаются: точная физика (отражения, механика, анатомия движения), очень плотные текстуры и детализированные диаграммы по-прежнему дают ошибки, которые проще заметить при внимательной проверке, чем объяснить модели в следующем запросе. OpenAI явно отмечают, что такие задачи требуют ручной верификации и остаются направлением для дальнейшей разработки.

Заключение

С gpt-image-2 OpenAI закрывают главный изъян ИИ-генераторов последних двух лет – нечитаемый текст внутри изображения – и одновременно подтягиваются к Google по функциям, которые ушли вперёд в ноябре 2025-го и феврале 2026-го. Практическая ценность для обычного пользователя – возможность получить готовую обложку, меню, плакат или серию из восьми связанных кадров в одном запросе. Для разработчиков – прозрачный API с понятной тарификацией и поэтапным отказом от DALL·E. Из открытых вопросов остаётся архитектура модели: без её раскрытия трудно предсказать, на каких запросах gpt-image-2 сломается системно, а на каких – случайно.